Bron: Khadijah Elshayyal , Shereen Fernandez

middleeasteye 2 juni 2024 ~~~

Kunstmatige intelligentie wordt gebruikt om Palestijnen uit te wissen, of dat nu gebeurt met wapens tegen hele bevolkingsgroepen of in schoongepoetste beelden die de gruwelen verbergen die hen worden aangedaan.

De afgelopen acht maanden zijn we getuige geweest van onuitsprekelijke gruwelen als gevolg van de oorlog van Israël tegen Gaza.

Na het meest recente offensief tegen een tentenkamp voor ontheemde Palestijnen in Rafah op 26 mei, zag de wereld hoe een baby zonder hoofd werd vastgehouden terwijl lichamen in as veranderden en op de achtergrond branden woedden. Vijfenveertig mensen werden gedood die zondagavond in wat waarschijnlijk een vergeldingsaanval was nadat het Internationaal Gerechtshof Israël had bevolen om de militaire operaties in Rafah te stoppen.

Deze apocalyptische taferelen maken ons weer duidelijk dat Palestijnen niet kunnen ontsnappen aan bombardementen.

De niet aflatende aanval sinds 7 oktober heeft geleid tot meer dan 36.000 vermoorde Palestijnen – degenen die vastzitten onder het puin niet meegerekend – tienduizenden gewonden en bijna twee miljoen binnenlandse ontheemden als gevolg van het strategische en doelbewuste geweld van Israël. Deze scènes circuleerden op sociale media met een ongekend volume in wat is beschreven als “de eerste live gestreamde genocide”.

Er is geen gebrek aan materiaal dat wordt uitgezonden vanuit het hart van Gaza als een bewijs van de terreur die zich in realtime ontvouwt. Een verontrustend, zij het voorspelbaar, aspect in dit tijdperk van influencers is hoe de dappere Palestijnse stemmen die documenteren en uitzenden naar de rest van de wereld voor ons allemaal bekende namen zijn geworden.

Alleen al de hoeveelheid rauwe, gruwelijke beelden die circuleren op sociale media betekent dat mainstream nieuwsbronnen al lang zijn verdrongen als primaire bron van nieuws ten gunste van TikTok, Instagram en X.

We volgen de feeds van jonge mensen ter plaatse die niet alleen beelden delen, maar ook een kijkje in hun leven en persoonlijke ervaringen. We delen in hun angst en hun verdriet, en we maken ons zorgen om hun veiligheid als ze niet hebben gepost; of ze de nacht wel hebben overleefd.

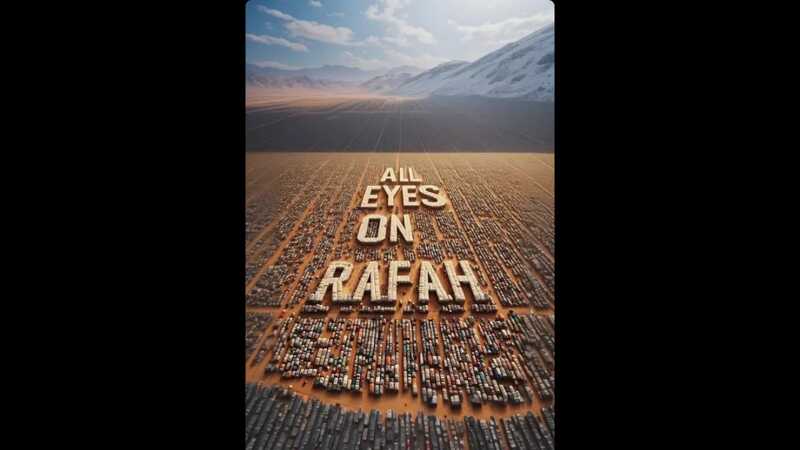

In de context van dit alles hebben we met grote belangstelling gekeken naar de snelheid waarmee het inmiddels alomtegenwoordige Instagram-sjabloon “All Eyes on Rafah” viraal ging.

Wat verbeteren we door een AI-gegenereerde afbeelding te plaatsen in plaats van een echte? Wat beschermen we precies?

De afbeelding, gegenereerd door kunstmatige intelligentie (AI), bestond uit witte tenten met daarboven een eindeloze uitgestrektheid van netjes in elkaar gezette tenten van verschillende tinten en overschaduwd door sneeuwwitte bergen.

De woorden in vette hoofdletters en het keurige beeld lijken niet bij elkaar te passen; de realiteit ter plekke in Rafah is heel anders dan wat er wordt gedeeld. Maar misschien maakte dat het juist zo makkelijk om te delen.

Het kan zijn dat de volledige ontsmetting en het opzettelijk weglaten van grafische beelden het “delen” makkelijker maakte voor gebruikers van sociale media in een tijd waarin “beïnvloeders” en beroemdheden zwaar worden bekritiseerd voor hun gebrek aan engagement op Palestina.

Maar als gemak of comfort doorslaggevende factoren zijn voor de inhoud die we delen, dan is de fundamentele vraag die we onszelf moeten stellen: wat verbeteren we door dit beeld te plaatsen in plaats van een levensecht beeld? Wat beschermen we precies?

Digitaal activisme

Met het uitbreken van de oorlog tegen Gaza kwam er een opmerkelijke verschuiving in hoe we omgaan met technologie en de digitale ruimte. Studenten die protesteren tegen de gruweldaden worden vaak bedreigd met doxxing, terwijl men zich ook zorgen maakt over professionele gevolgen als werkgevers worden getagd in of op de hoogte worden gesteld van posts op sociale media.

In een recent geval werd Faiza Shaheen, een toekomstige kandidaat voor de Labour Party in Groot-Brittannië, naar verluidt ontslagen omdat ze tweets had geliked waarin ze Boycot, Desinvestering en Sancties (BDS) tegen Israël ondersteunde. Activistische intimidatie is echt, net als de impact ervan, en dus kan de viraliteit van de “Rafah” post, die de 40 miljoen shares heeft overschreden, te maken hebben met het gevoel dat er veiligheid is in getallen.

Veel critici van de door AI gegenereerde afbeelding leken het te vergelijken met andere virale gebaren die als oppervlakkig en performatief worden beschouwd, zoals de beruchte zwarte profiel vierkanten en bijbehorende #BlackoutTuesday posts, die populair werd tijdens de protesten tegen George Floyd in 2020 om solidariteit te tonen met zwarte gemeenschappen tegen het gewelddadige onrecht en de uitsluiting waar ze mee te maken hadden.

Anderen hebben gesuggereerd dat de “Rafah” post het bewijs is van de politieke capaciteiten van kunst en haar potentieel als een vorm van protest en verzet, gezien de strategische manier waarop het ontbreken van “horror” ook kan hebben bijgedragen aan het enorme bereik van de afbeelding door het omzeilen van filter- of blokkeermechanismen.

Maar deze aflevering zet ons aan om dieper na te denken over de rol en de impact van AI in online verhaalvorming en activisme. Het gemak en de snelheid waarmee AI-inhoud kan worden gegenereerd, is door elkaar heen geprezen als iets fascinerends, amusants en zelfs machtigs.

Typ een paar trefwoorden in en je hebt binnen handbereik een afbeelding (of tekst) die op de een of andere manier onze gedachten uitdrukt en tegelijkertijd onze angsten en vooroordelen blootlegt.

Net zoals de digitale ruimte aantoonbaar een veelheid aan mogelijkheden voor activisme heeft geopend, roept het ook vragen op over de doeltreffendheid van virale online trends in het bereiken van doelen.

Wat is in dit neoliberale tijdperk precies de volledige impact van hashtags en massale “blokkades”?

Hoewel ze inderdaad effect kunnen hebben op de beoogde doelen, welke informatie over onszelf geven we door aan sociale mediabedrijven in onze betrokkenheid bij dit activisme, en zijn dergelijke trends potentieel hulpmiddelen om activisme te hoeden, in te dammen of te pacificeren?

AI-genocide

Als reactie op de populariteit van de “Rafah”-afbeelding werden er talloze tegenafbeeldingen gemaakt, waaronder een Hamas-strijder die een geweer vasthoudt en op een baby neerkijkt, met in hoofdletters de vraag “Waar waren je ogen op 7 oktober?

Wat onze politieke overtuigingen ook zijn, het is duidelijk dat AI-gegenereerde content onze manier van verhalen vertellen aanmoedigt en een inhoudsgericht publiek stimuleert. Tegelijkertijd wordt het moeilijker om onderscheid te maken tussen wat waar en onwaar is, omdat het aantal bots en nepaccounts die ideologieën verspreiden alleen maar toeneemt en ons wantrouwen jegens technologie zal verdiepen. Maar wat dit feit extra ingewikkeld maakt, is dat we ons op een moment bevinden waarop burgerjournalistiek op haar hoogtepunt is.

We zijn letterlijk getuige van de eerste AI-oorlog die zich in realtime ontvouwt, of het nu gaat om virale, door AI gegenereerde berichten die verhalen voeden of om het gebruik van AI-surveillance en wapens om de meeste schade aan te richten.

Hoewel de meningen verschillen over de vraag of het delen van door AI gegenereerde inhoud acceptabel is, moeten we ons dringend buigen over de manier waarop AI wordt gebruikt om oorlogvoering te bevorderen door middel van surveillance en “gerichte” moorden.

In 2021 schepte Israël op over het gebruik van innovatieve technologie tijdens een inval die bekend stond als “Operation Guardian of the Walls”, waarbij 261 Palestijnen werden gedood toen Gaza een jaarlijkse proeftuin werd voor AI-wapens.

Hoewel de meningen verschillen over het delen van door AI gegenereerde inhoud, moeten we dringend aandacht besteden aan de manier waarop AI wordt gebruikt om oorlogsvoering te bevorderen.

De voortdurende afhankelijkheid van het Israëlische leger van AI-markerings- en volgsystemen zoals Lavender, ‘The Gospel’ en ‘Where’s Daddy?’ verleent angstaanjagend verstrekkende bevoegdheden aan programma’s die gemachtigd zijn om te doden met behulp van ‘domme bommen’ (of ongeleide raketten) met minimaal menselijk toezicht.

Het gebruik van drones en geavanceerde surveillanceprogramma’s om de levens van Palestijnen te ontwrichten en tegelijkertijd de levens van Israëlische soldaten te sparen door een invasie op de grond te voorkomen, laat zien hoe AI-technologieën worden gebruikt om sommige levens voorrang te geven boven andere.

Op deze manier wordt AI gebruikt om de levens van Palestijnen te ontmenselijken, uit te wissen en te bedreigen, of dat nu opzettelijk gebeurt door wapens die op hele bevolkingsgroepen worden ingezet of misschien onbedoeld door de verspreiding van gezuiverde beelden die de gruwelen verbergen die routinematig tegen Palestijnen worden begaan.

In deze urgente tijden zal het verdoezelen van de waarheid door middel van AI ons zicht alleen maar vertroebelen, een paradox waar we alert op moeten blijven terwijl de hoeveelheid content binnen handbereik onverminderd blijft toenemen.

De meningen in dit artikel behoren toe aan de auteurs en weerspiegelen niet noodzakelijkerwijs het redactionele beleid van Middle East Eye.

Topfoto: Palestijnen verzamelen zich op de plaats van een Israëlische aanval op een kamp voor binnenlandse ontheemden in Rafah op 27 mei 2024 (Eyad Baba/AFP)

Khadijah Elshayyal is onderzoeker aan de Universiteit van Edinburgh, doet onderzoek naar digitale moslimruimtes en is auteur van Muslim Identity Politiek: Islam, activisme en gelijkheid in Groot-Brittannië (IB Tauris, 2019).

Dr. Shereen Fernandez is een ESRC Postdoctoral Fellow aan de LSE. Onlangs promoveerde ze op een onderzoek naar de werking van de preventieve leerplicht in scholen. Ze tweet @shereenfdz.